Anzeige

Home » Praxistest: DaVinci Resolve 20

Praxistest: DaVinci Resolve 20

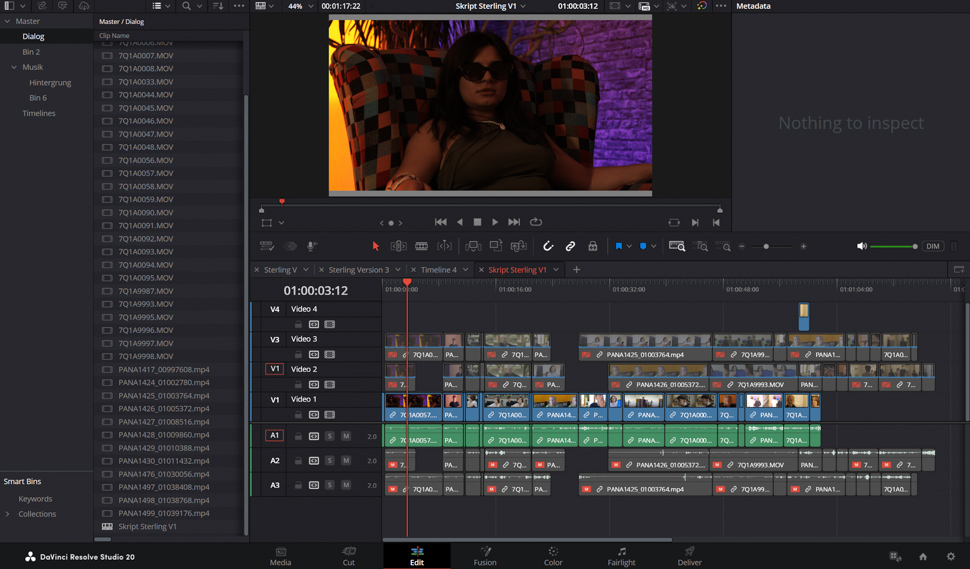

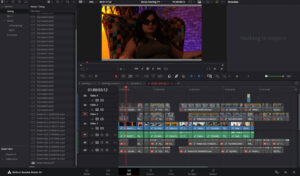

Die Edit-Seite mit neuen Komfort-Funktionen

Die meisten neuen Funktionen auf der Edit-Seite sind Erweiterungen vorhandener KI-Funktionen und basieren auf dem Transkribieren von Sprachaufnahmen. Zu der Transkriptions-Funktion wurden zusätzliche Sprachen hinzugefügt, die in dem Basis-Installer nicht enthalten sind und über den »Extras Download Manager« heruntergeladen werden müssen. Das sind dann nochmal 6,4 GB.

Bei einem direkten Vergleich automatisch erstellter Untertitel scheint die Transkription in Deutsch tatsächlich etwas besser geworden zu sein, wenn es auch immer noch viele Stellen gibt, an denen nachgebessert werden muss und die Sprechererkennung nicht immer funktioniert. Das Ergebnis ist deutlich besser, wenn man die entsprechende Sprache im Dialogfenster auswählt anstelle der Auto-Funktion mit der automatischen Spracherkennung. Dann wechselt die KI zwischendurch gelegentlich einfach mal die Sprache.

Transkriptionen lassen sich jetzt mit Timecode und Sprecher als PDF-Datei exportieren.

Dass der automatische Videoschnitt immer mehr ein Thema wird, zeigt Resolve 20 vor allem mit zwei Funktionen: Es ist etwas paradox – eine hat in dieser ersten Version kaum einen praktischen Nutzen, die andere ist wirklich gut. Die Intelliscript-Funktion soll aus den transkribierten Audiodateien von Dialogen und dem Script automatisch einen Rohschnitt erstellen. Dabei werden nur Dialoge berücksichtigt. Beschreibungen einer Szene beherrscht diese Funktion noch nicht. Diese sollten sich auch nicht in dem Ordner befinden, der hierfür verwendet wird, da die Erkennung einzelner Personen oft nicht auf den Punkt ist und auch Texte wie »Kamera läuft« gelegentlich einfach in den Dialog integriert werden.

Der automatische Schnitt nach einem Drehbuch mit Intelliscript ist ein »Proof of Concept«, braucht aber noch sehr viel Nacharbeit.

Insgesamt funktioniert das nur, wenn man die Clips gut vorbereitet, also alle Clips durchschaut und eine genaue Vorauswahl erstellt. Gibt es mehrere Takes, ist kein genaues Prinzip erkennbar, nach dem DaVinci die Dateien für die Timeline auswählt. Er bietet zwar Alternativen auf mehreren Spuren, aber das Durchsehen dieser Clips dauert länger, als wenn man sich die besten Takes einfach im Media Pool heraussucht. Mit genug Vorbereitung landen die Dateien nach dem Berechnen durch die KI auch mit Schnitt/Gegenschnitt und gelegentlichen Totalen in der Timeline. In der Zeit, die es zu berechnen braucht, hat man den Rohschnitt normalerweise selbst schneller erstellt und dabei ein sehr viel besseres Ergebnis. Selbst bei einem sehr genau vorbereiteten einzelnen Dialog zwischen zwei Personen gab es zwar eine Timeline mit den entsprechenden Schnitten, doch machen die Schnitte und die Längen kaum Sinn, so dass mehr Zeit in die Nacharbeit gesteckt werden muss, als es dauert, diese Szene selbst zu schneiden. Es ist ein erster Versuch, der grundsätzlich zeigt, dass es funktionieren kann. Aber in diesem Stadium ist es keine Arbeitserleichterung.

Dass eine automatische Schnittfunktion durchaus funktionieren kann, zeigt KI Multicam SmartSwitch. Diese schneidet eine Multicam-Datei immer auf den gerade aktiven Sprecher und da es keine Takes gibt und der Schnittpunkt sehr viel genauer definiert werden kann, spart diese Option tatsächlich Zeit beim Schnitt. Wenn es eine Totale gibt, kann in einem Dialogfenster spezifiziert werden, wie oft und wie lange diese gezeigt werden soll. Solange sich die Kamera nicht bewegt, ist das Ergebnis zumindest sauber geschnitten.

Bei einer Kamera, die zwischen zwei Sprechern schwenkt, schneidet die Funktion gerne mal mitten in der Bewegung. Wie sinnvoll dieses Feature dann aber wieder ist, hängt davon ab, wie viel Erfahrung man mit dem Live-Schnitt von Multicam-Dateien hat. Bei einem 15-Minuten-Interview dauerte die Berechnung fast 8 Minuten. Wer keine Erfahrung darin hat, Multicam-Dateien zu schneiden, der bekommt mit wenig Nacharbeit ein gutes Ergebnis.

Die Untertitel können jetzt mit Templates (aus Fusion) animiert werden. Die Titel aus der Kategorie »Animated« werden lediglich auf die Untertitelspur gezogen und werden dann im Inspector bearbeitet. Natürlich lassen sich wieder eigene Presets in Fusion erstellen. »Word Highlight« beispielsweise hebt die Wörter, die gesprochen werden, mit einem Umrandungs-Effekt hervor. Es scheint aber, die Hervorhebung erfolge lediglich nach der Länge des Textes und der Zeit und treffe oft nicht das tatsächlich gesprochene Wort.

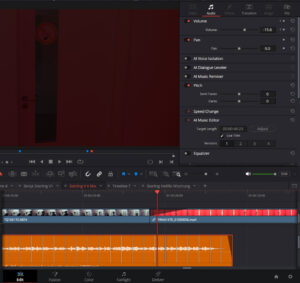

Ein wirklich gutes Werkzeug ist der AI Music Editor, der die Länge eines Musikclips fast automatisch an eine vorgegebene Länge anpasst. Im Grunde macht er, was man bisher manuell angefertigt hat: einen passenden Beat finden, die Musik dort abschneiden oder einen Loop herausschneiden und den Loop oder das Ende des Songs anstückeln. So funktioniert das vor allem bei rhythmusbetonten Genres sehr gut.

Der AI Music Editor verändert die Länge eines Musikstücks nach den Möglichkeiten des Beats, ohne dass es unnatürlich klingt.

Bei sphärischen Klängen ist das Ergebnis aber meist auch nicht schlecht und Fehler fallen dort weniger auf. Dabei gibt es zwei Optionen: Entweder die neue Länge des Musikstückes wird numerisch eingegeben, dann dauert es ein paar Sekunden und das Ergebnis ist in der Timeline. Mit der Option »Live Trim« wird der Clip in der Timeline einfach auf die entsprechende Länge gezogen. Nach wenigen Sekunden hat Resolve das Musikstück berechnet und gekürzt oder verlängert. Zudem stehen immer vier Varianten zur Verfügung, die unterschiedliche Längen bereitstellen, wenn es nicht genau möglich ist, das Musikstück auf die entsprechende Stelle im Video anzupassen. Zusätzlich gibt es jetzt eine automatische Beat Detection in Musikdateien, die den Beat anzeigt und als visuelle Referenz für den Schnitt verwendet werden kann. Endlich – Audio-Sequenzer können das schon seit Jahrzehnten.

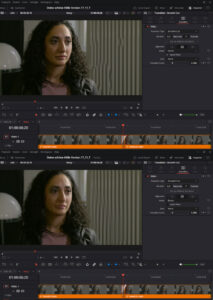

Die Speedwarp-Funktion bietet bei Smooth Cuts wesentlich bessere Ergebnisse. Strukturierte Hintergründe (u. a. ohne Speedwarp) bleiben allerdings ein Problem.

Der Smooth-Cut-Filter, um Jumpcuts zu verbergen, hat jetzt eine Speedwarp-Funktion. Das bietet oft bessere Ergebnisse bei Details in Gesichtern wie Augen und der Blickrichtung, und bei wenig Bewegung des Protagonisten ist der Schnitt oft gar nicht mehr zu erkennen oder zumindest weniger.

Die Super-Scale-Funktion für dreifache und vierfache Vergrößerung bietet nicht nur drei Settings wie bisher, sondern Schärfe und Noise Reduction lassen sich jeweils detaillierter mit einem Regler einstellen. Das kann eine geringfügige Verbesserung bringen, vor allem beim Denoising. Das Schärfen wirkt schnell überschärft und sollte auch weiterhin nur geringfügig eingesetzt werden. Insgesamt können Aufnahmen mit einem leichten Schärfeunterschied so sinnvoll verbessert werden.

Seite 1: Unterschiede Resolve / Studio-Version, KI-Spracherzeugung

Seite 2: Die besten neuen Funktionen

Seite 3: Edit-Seite

Seite 4: Audio, Color und Fusion

Seite 5: Fazit

Autor: Christoph Harrer

Bildrechte: Christoph Harrer, Blackmagic Design

Anzeige

Most Popular

Anzeige

Newsletter

Anzeige

Anzeige

Anzeige