Anzeige

Home » Bachelorarbeit: Audio-Postproduktion in Projektstudios

Bachelorarbeit: Audio-Postproduktion in Projektstudios

In seiner Bachelorarbeit, die an der Hochschule der Medien Stuttgart im Studiengang Audiovisuelle Medien entstanden ist, behandelt Dominik Heer mögliche Einsatzbereiche und den Aufbau von digitalen Projektstudios in der Audio-Postproduktion. Im Vordergrund dieser Zusammenfassung seiner Arbeit stehen möglichst günstige Produktionsmittel im Bereich Film- und Video-Sound-Bearbeitung, die trotz des niedrigeren Preises eine gute Tonqualität und eine effektive Arbeitsweise bieten. Außerdem erläutert Heer die Grundlagen und Arbeitstechniken in der Audionachbearbeitung speziell bei Film und Video, und er untersucht in Tests diverse Soundparameter zu Raumklang und Rauschunterdrückung.

Für und Wider: Digitales Projektstudio und großes Tonstudio

Wie jedes technisch geprägte Berufsfeld entwickelt und verändert sich auch die Audio-Postproduktion für Film und Video mit der Verfügbarkeit von neuen Technologien. In den 90er Jahren erlebte die Audiopostproduktion eine tiefgreifende Veränderung: Große Studios verloren immer mehr Aufträge an kleine, spezialisierte Projektstudios, in denen dank der Digitaltechnik kostengünstiger gearbeitet werden konnte. Mittlerweile kann beinahe jeder Arbeitsschritt in der Audio-Postproduktion computergestützt in Projektstudios durchgeführt werden — wenn auch teilweise mit Einschränkungen beim Workflow. Lediglich die Filmmischung und einige andere, spezielle Aufgaben wie Nachsynchronisation und Foley-Aufnahmen, sind oftmals nur in größeren Tonstudios mit entsprechender Zusatzausstattung möglich.

Für Auftraggeber, die keine Audioprofis sind, ist es allerdings schwer, die Qualität eines Projektstudios auf den ersten Blick zu beurteilen. Eine gute Optik verrät nicht immer etwas über die technische Ausstattung und Qualifikation des Studios. Ein Zertifikat von THX oder TMH soll die Einhaltung hoher Qualitätsstandards garantieren. Beide Firmen begleiten die Studiobetreiber beim Bau, der Einrichtung und bei der Auswahl der Geräte. Die Zertifizierung ist allerdings kostspielig und bei dem harten Preiskampf in der Branche gilt es zu entscheiden, ob sich die Investition auch beim eigenen kleinen Projektstudio lohnt.

Die geeigneten Boxen für das Monitoring

Monitoring steht für die »Überwachung und Kontrolle eines Arbeitsprozesses« im Falle der Audio-Postproduktion ist dies im wesentlichen das Abhören. Die verwendeten Lautsprecher haben deshalb einen großen Einfluss auf die Produktionsqualität. Neben einer neutralen Frequenzwiedergabe muss der verwendete Lautsprecher auch eine hohe Dynamik aufweisen. Eine Sound-Anlage für die Filmmischung muss Pegelspitzen von bis zu 103 dBSPL[C] pro Kanal am Abhörort erreichen und weitestgehend verzerrungsfrei wiedergeben.

Die Dynamik einer Sound-Anlage wird aber nach unten hin durch Hintergrundgeräusche im Raum und das Grundrauschen des Lautsprechers selbst begrenzt. Viele Lautsprechermodelle rauschen so stark, dass dies am Abhörplatz in zwei bis drei Metern Entfernung noch deutlich zu hören ist. Bei zu hohem Geräuschpegel aus Hintergrundgeräuschen und Grundrauschen können leise Passagen in der Tonspur aber nicht mehr korrekt beurteilt werden, da der Sound von den Störgeräuschen verdeckt wird.

Weitere Faktoren für die Qualität eines Studiomonitors sind sein Ausschwingverhalten (Impulstreue) und die Phasenstabilität. Beide Werte werden in Datenblättern normalerweise nicht angegeben. Im Zweifel zählt der Hörtest mit bekannten Sound- und Musikbeispielen. Generell lässt sich sagen, dass Bassreflex- und Transmissionline-Lautsprecher ein schlechteres Impulsverhalten haben, als Lautsprecher mit geschlossenem Gehäuse. Diese werden jedoch wegen ihrer schwachen Basswiedergabe eher selten eingesetzt

Die Phasenstabilität des Lautsprechers wird durch die Trennfilter (Frequenzweiche) bestimmt, die das Frequenzspektrum bei einer gewissen Frequenz (Trennfrequenz) aufteilen und jeweils den Hochtöner mit den hohen Frequenzen versorgt und den Tieftöner mit den tiefen. Die Auftrennung des Frequenzspektrums durch die Frequenzweiche geht nicht ohne Verfälschungen des Signals vonstatten. Analoge Filtermodule haben die Eigenschaft, das Signal in Abhängigkeit der Frequenz zu verzögern. Das bedeutet, dass Frequenzen im Bereich der Trennfrequenz verzögert wiedergegeben werden (Phasenverzerrung) und dadurch Impulse weichgezeichnet werden, worunter wiederum die räumliche Wiedergabe leidet.

Die stabilste Phasenlage haben generell Lautsprecher mit digitaler Frequenzweiche. Hier wird das vorzugsweise digital vorliegende Signal mit linearphasig arbeitenden digitalen Filtern aufgetrennt. Nach der Trennung durchlaufen die Frequenzspektren separate Digital-Analog-Wandler und werden dann verstärkt. Ein angenehmer Nebeneffekt ist die geringere Störanfälligkeit von digitalen Lautsprechern durch die digitale Signalübertragung.

Aufstellungsort der Lautsprecher

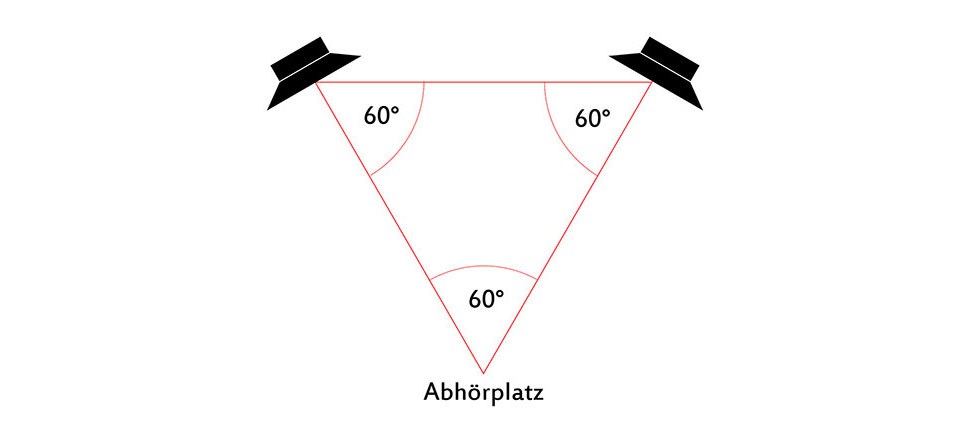

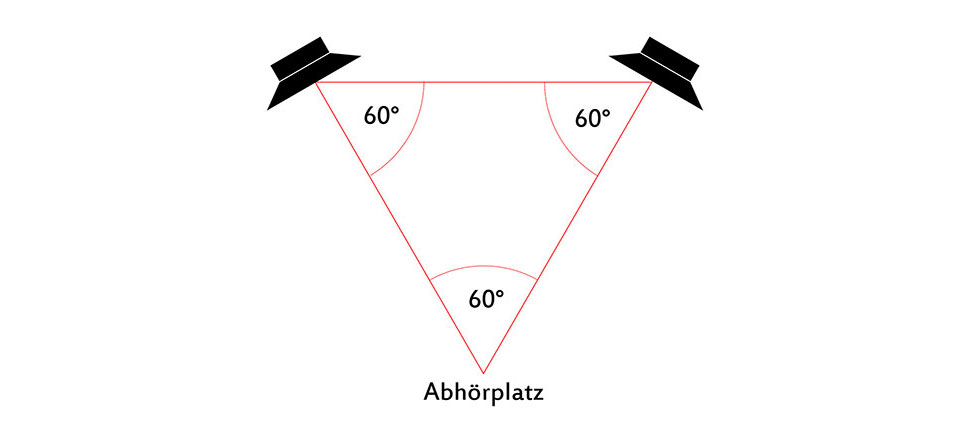

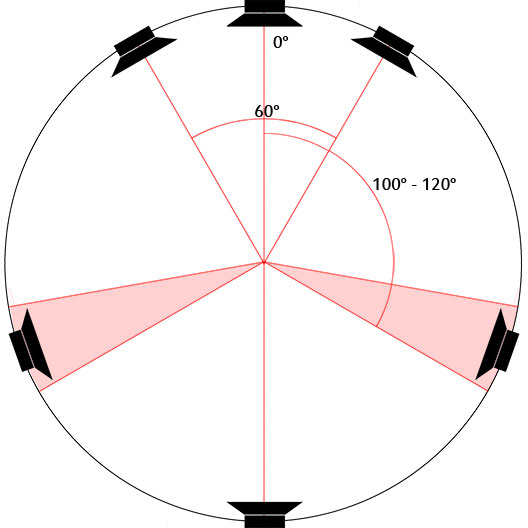

Ein Projektstudio, in dem für verschiedene Medien (DVD, TV, Internet) produziert wird, sollte eine variable Aufstellung der Lautsprecher erlauben, da sich die richtige Aufstellung abhängig vom Format, für das produziert wird, unterscheidet. Bei Stereo müssen die Lautsprecher zusammen mit dem Abhörort in einem gleichseitigen Dreieck aufgestellt werden. Die Länge der Seiten wird bestimmt durch die Breite des Bildschirms. Idealerweise beträgt der Abstand der Lautsprecher vom Bildschirmrand eine Bildschirmbreite.

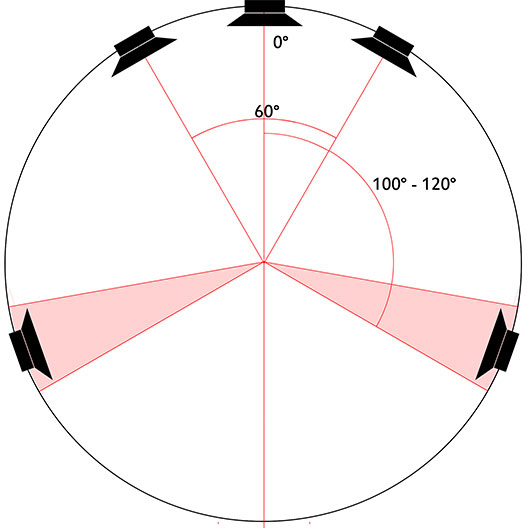

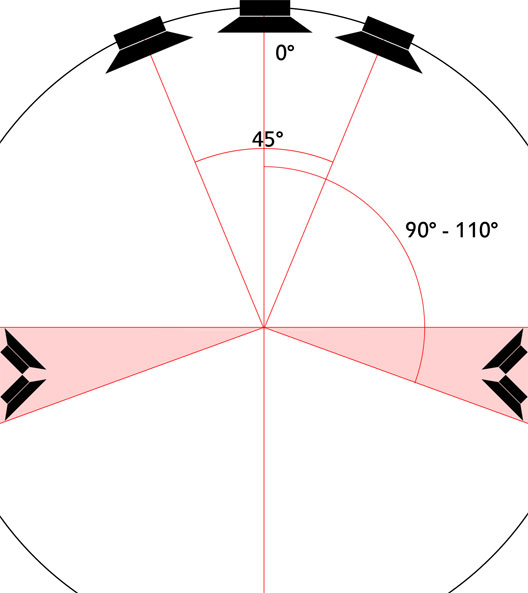

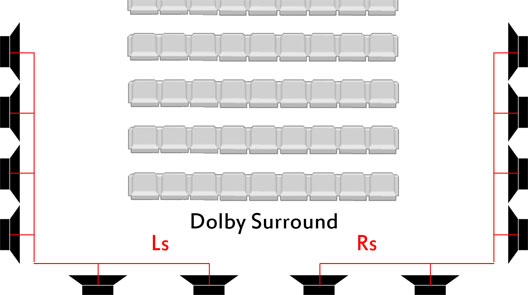

Der am weitesten verbreitete Surround-Standard für 5.1 ist die Empfehlung ITU-R BS 775. Die ideale Aufstellung des Center-Lautsprechers ist hinter einer mikroperforierten, schalldurchlässigen Leinwand. Bei der Verwendung von Bildschirmen kann der Center-Lautsprecher in gewissen Grenzen aus der Ohrebene heraus angehoben werden.

Die Aufstellung nach ITU ist für die Arbeit an Filmen allerdings nur bedingt geeignet. Die Empfehlung der Lautsprecheraufstellung im Heimkino nach THX passt besser zur Situation im Kino. Im Kino befinden sich alle Frontlautsprecher hinter der Leinwand. Der kleinere Winkel der Frontlautsprecher in der THX-Empfehlung kommt dem entgegen. Die Surround-Wiedergabe im Kino geschieht durch Arrays von vielen Satellitenlautsprechern an den Raumwänden. Im Heimkino wird deshalb ebenfalls eine diffuse Surround-Wiedergabe empfohlen. Diese kann mit Dipol-Lautsprechern oder ebenfalls mit Arrays erreicht werden.

Computer-Hardware

Der Kern eines Projektstudios ist der Computer. Auf ihm läuft neben dem zentralen Audiobearbeitungsprogramm auch die ergänzende Software. Die Anforderungen an den Computer sind in der Audiopostproduktion relativ hoch, da Audiobearbeitung sowohl rechenintensiv ist, als auch die Festplatten und den Arbeitsspeicher stark belastet. Die Geschwindigkeit des Prozessors bestimmt die maximale Anzahl der verwendbaren Echtzeiteffekte (Plug-Ins). Ordentlich Arbeitsspeicher (mehr als 2 GB) ist nötig, wenn Faltungshall verwendet wird und wenn bei Sounddesign oder Filmmusik-Komposition viele virtuelle Klangerzeuger zum Einsatz kommen.

Neben der Leistung des Computers ist die Geräuschentwicklung ein entscheidender Aspekt bei der Wahl des Computers, sofern dieser nicht in einen separaten Geräteraum ausgelagert wird. Wenn entsprechend leise Lautsprecher verwendet werden, wird jeder lüftergekühlte Computer im Arbeitsraum hörbar sein — besonders, wenn der Computer bis an die Grenzen seiner Leistung ausgelastet wird und die Lüfter dabei maximal arbeiten. Eine gute Reduktion von Störgeräuschen kann durch passive Kühlung erreicht werden. Dabei wird die Abwärme von Prozessor, Grafikkarte und Netzteil über Heatpipes an ein spezielles Gehäuse mit Kühlrippen an den Seiten geleitet.

Weiter Störgeräuschquelle neben den Lüften ist das Netzteil. Auch hier gibt es große Unterschiede, dem Autor ist allerdings kein Netzteil bekannt, das völlig geräuschfrei arbeiten würde.

In einem digitalen Studio mit Minimalausstattung kann, abgesehen von einem flexiblen Audio-Interface, auf sämtliche zusätzliche Audio-Hardware verzichtet werden. Alle Werkzeuge für die Audio-Postproduktion sind in Form von Software verfügbar. Für einen besseren Workflow bei der Filmmischung kann jedoch die Anschaffung eines DAW-Controllers in Betracht gezogen werden. Dieses Steuergerät bietet für viele Funktionen von Audiobearbeitungsprogrammen Regler — etwa fürs Pegeln der Lautstärke, die Panorama-Einstellung und vieles mehr. Der Controller nutzt dabei aber die Ressourcen des Computers — im Gegensatz zu einem Mischpult, das über eine eigene Signalverarbeitung verfügt.

Audio-Software

Die Wahl des verwendeten Audiobearbeitungsprogramms ist eine wichtige Entscheidung beim Betrieb eines Projektstudios. In der Audiopostproduktion dominieren im Bereich der Projektstudios zwei Softwares den Markt (Stand: Juli 2010): Pro Tools HD 7.4 und 8 von Digidesign einerseits, sowie Nuendo 5 von Steinberg. Pro Tools HD ist der Marktführer in der Audiopostproduktion, was sich jedoch auch im Preis niederschlägt. Während die alternative Software Nuendo zusammen mit einem guten Audio-Interface ab rund 2.700 Euro zu haben ist, kostet das günstigste Pro Tools HD System (Die HD-Software gibt es nicht ohne Pro Tools Hardware) plus Digitranslator für OMF-Support rund 10.500 Euro.

Von der Verwendung der wesentlich günstigeren Software Pro Tools LE sollte nach Meinung des Autors Abstand genommen werden, wenn man professionell mit Schwerpunkt im Audiobereich arbeiten will, da einige wichtige Features fehlen, wie zum Beispiel der Latenzausgleich für Audiosignale mit Echtzeiteffekten.

Da Pro Tools HD der Industriestandard ist, muss bei der Anschaffung eines alternativen Systems eine Übersetzer-Software, zum Beispiel Pro-Convert von SSL angeschafft werden. Damit können Pro-Tools-Projekte von anderen Studios gelesen oder passend für diese ausgegeben werden. Beide Audiobearbeitungsprogramme laufen sowohl auf Windows als auch auf MacOS Leopard. Nach Ansicht des Autors ist es reine Geschmackssache, welches Betriebssystem verwendet wird. Auch die Hardware unterscheidet sich qualitativ nicht signifikant. Ein Windows-PC mit hochwertigen Komponenten ist zumindest unter dem Aspekt der Audiobearbeitung mit einem Apple-Computer gleichwertig.

Film- und Videosound-Formate

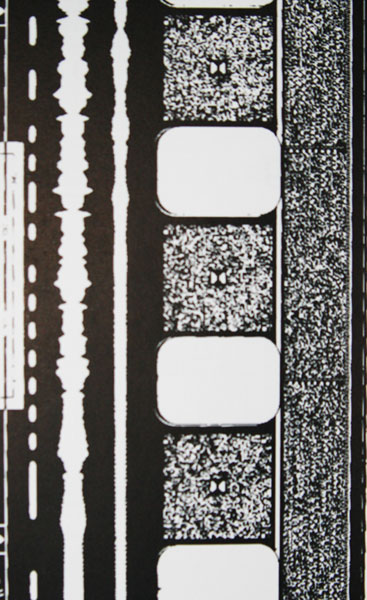

Viele Haushalte verfügen lediglich über Stereo-Wiedergabe. Durch die wachsende Zahl an 5.1-Anlagen bei den Endkunden wächst aber der Druck, auch kleinere, nicht fürs Kino konzipierte Produktionen mit Surround-Ton zu produzieren. Die drei gängigsten Formate sind hierbei Dolby Digital, DTS und SDDS. Alle basieren auf dem 5.1-Standard.

SDDS kann aber auch 7.1 Kanäle speichern und wiedergeben, die Erweiterungen Dolby Digital EX und DTS ES erlauben die Wiedergabe von 6.1 Kanälen. 7.1 bietet fünf Frontkanäle für eine bessere Ortung des Sounds bei großen Leinwänden, 6.1 erweitert das Surround-Feld um einen rückwärtig angeordneten Lautsprecher oder ein Lautsprecher-Array an der Rückseite des Raumes

Formate mit mehr als 8 Kanälen sind mittlerweile durch die neue Infrastruktur in digitalen Kinos theoretisch möglich, es fehlen aber noch konkrete Vorschläge, Normierungen und Produktionsmethoden, sodass vermutlich noch viele Jahre in 5.1, 6.1 oder 7.1 produziert werden wird. Derzeit wird an dem Format 10.2 von TMH gearbeitet, das in einigen Testkinos in den USA bereits eingesetzt wird.

Geeigneter Video-Codec für die Audionachbearbeitung

Video in Audioanwendungen stellt seit jeher aus zwei Gründen ein Problem dar: Erstens erfordert Video Ressourcen, die dann nicht mehr für die Audiobearbeitung genutzt werden können und zweitens führt ein ungeeignet kodiertes Videosignal dazu, dass die Gesamt-Performance stark eingeschränkt und die Navigation innerhalb des Projekts beeinträchtigt wird

Für eine Entlastung des Computers können externe Videozuspielgeräte angeschafft werden, die dann über Timecode synchronisiert werden. Dies ist jedoch nicht unbedingt nötig, wenn das Videomaterial im richtigen Codec in das Audioprojekt importiert wird. Generell lässt sich sagen, dass Long-GoP-Videos mit Interframe-Kodierung in Audiobearbeitungsprogrammen eher ungeeignet sind, weil hierbei für die Wiedergabe Zwischenbilder berechnet werden müssen. Besonders negativ wirkt sich dies aus, wenn viel vor- und zurückgesprungen wird. Codecs mit Intraframe-Kodierung sind hier besser geeignet.

Ein Performance-Test für Video-Codecs mit Quicktime 7 in Cubase 5 ergab, dass sich der Codec »Motion JPEG B« am besten für die Einbindung in ein Audiobearbeitungsprogramm eignet. Da die Datei mit diesem Codec sehr groß wird, ist er allerdings nicht für den Datenaustausch via Internet geeignet. Hierfür empfiehlt es sich, das Video in H.264 mit einer hohen Bildqualität zu codieren und nach Erhalt in »Motion JPEG B« umzuwandeln.

Neben dem Video erhält das Projektstudio vom Schnittplatz außerdem die Audiodaten, die im Idealfall bereits synchron zum Bild angelegt sind. Die Audiodaten müssen möglichst unbearbeitet in der Audiopostproduktion ankommen. Dafür wurde das Containerformat OMF entwickelt. In einer OMF-Datei können alle verwendeten Audiodateien eines Videoschnittprojekts enthalten sein, sowie eine XML-Datei mit der Position jeder einzelnen Audiodatei und einer Information darüber, auf welcher Spur sich diese befindet. Für weitere Flexibilität in der Audiobearbeitung können die Audiodateien noch einen Teil vor und hinter dem Clip beinhalten, so dass bei Überblendungen mehr Material zur Verfügung steht.

Die Produktionskette

O-Ton und Dialogbearbeitung

In der O-Ton- und Dialogbearbeitung wird versucht, aus der EDL des Videoschnittplatzes und dem gesamten O-Ton-Material eine bereits flüssig klingende Tonspur zu schneiden. Das Hauptaugenmerk liegt dabei darauf, möglichst alle Dialoge aus dem O-Ton-Material zu gewinnen, da eine nachträgliche Aufnahme mit einem hohen Aufwand verbunden ist. Ob von der Auswahl der Dialoge, die während des Videoschnitts getroffen wurde, abgewichen werden darf, muss mit dem Regisseur abgeklärt werden.

Nachsynchronisation und Foley

Bei größeren Filmprojekten wird zum Teil bereits im Vorfeld entschieden, dass der Ton vom Set nur als Guide-Track für eine spätere Nachsynchronisation im Studio verwendet wird. So schaffen sich Regisseure am Set mehr gestaltungsfreiheit und Flexibilität, da sie sich nicht zusätzlich mit den Erfordernissen der Tonaufnahme auseinandersetzen müssen. Bezüglich der technischen Qualität ist dies ein Vorteil, da Sound und Dialoge später unter kontrollierten Bedingungen aufgenommen werden. Die meisten Hollywood-Produktionen werden daher auch in der Originalsprache nachsynchronisiert. Dies hat neben einem besseren Sound auch den Vorteil, dass für die Übersetzung des Films in andere Sprachen lediglich die Dialogspur ausgeschaltet werden muss. Sämtliche Bewegungsgeräusche der Darsteller liegen bereits separat vor und müssen nicht erneut in deutschen Synchronstudios aufgenommen werden.

Dem steht allerdings entgegen, dass das Spiel am Set fast immer authentischer ist und bessere Ergebnisse liefert als eine Studioaufnahme. Im Gegensatz zu amerikanischen Filmen, wo Wert auf den »Big Sound« gelegt wird, zählt bei deutschsprachigen Produktionen eher der Inhalt, so dass hier seltener nachsynchronisiert wird.

Die nachträgliche Aufnahme von Sounds und Dialogen ist in Projektstudios kaum möglich. Diese müssen in speziell dafür ausgestatteten ADR- und Foley-Studios gemacht werden.

In Foley-Studios stehen zahlreiche Requisiten für die Erzeugung von Geräuschen aller Art zur Verfügung. Wichtig sind dabei auch die verschiedenen Untergründe, wie Beton, Holz, Sand, Kies, Laminat (und andere) für die synchrone Aufnahme von Schritten. Der Geräuschemacher oder Foley-Artist stellt möglichst alle Geräusche, deren Quellen im Bild zu sehen sind, mit seinem Körper oder Requisiten nach.

Dialoge werden in einem ADR-Studio aufgenommen. ADR steht für »Automatic Dialog Replacement« und ist eine Technik zum schnellen Austausch von fehlerhaften Sätzen und Wörtern oder auch für die Nachsynchronisation bei fehlendem O-Ton, zum Beispiel bei Computeranimationen oder bei der Übersetzung eines Filmes in andere Sprachen.

Sounddesign

Wenn alle Dialoge und Bewegungsgeräusche in einer guten Qualität vorliegen, kommt das Sounddesign ins Spiel. Hier werden entweder vorhandene Klänge ersetzt, wenn sie nicht die gewünschte Wirkung haben, oder fehlende Klänge hinzugefügt. Der Sounddesigner kann dabei entweder auf eine Sound-Bibliothek zurückgreifen, den Sound aufnehmen, ihn mit synthetischen Mitteln oder durch Schichten von mehreren Klängen erzeugen. Außerdem werden im Sounddesign Atmos (Hintergrundatmosphären) hinzugefügt, die der Szene räumliche Tiefe und Zusammenhalt verleihen und oft auch dramaturgische Inhalte unterstützen.

Mischung

Sind alle Sounds aufgenommen, geschnitten, erzeugt und synchron zum Bild angelegt, beginnt der finale Schritt in der Audiopostproduktion: die Mischung. Kinofilme können nicht zuverlässig in Projektstudios gemischt werden. Kinomischstudios zeichnen sich durch ein extrem aufwändiges Monitoring aus und besitzen eine kinoähnliche Akustik, im Idealfall von THX zertifiziert. In Projektstudios können aber Mischungen für alle anderen Medien wie DVD, Fernsehen, Blu-ray oder Internet gemacht werden.

Die Aufgaben der Mischung sind vielfältig. Am wichtigsten ist die Gewichtung aller Sounds nach ihrer dramaturgischen Bedeutung. In einer guten Tonspur ist kein Sound zufällig, sondern erfüllt einen Zweck — und wenn es nur der ist, die im Bild zu sehenden Geräuschquellen hörbar zu machen. Aber auch das bewusste Weglassen oder Ausblenden von Klängen ist ein beliebtes dramaturgisches Mittel.

Eine weitere Aufgabe der Mischung ist es, Räumlichkeit zu schaffen. Bisher, im zweidimensionalen Kino, wurde die Räumlichkeit auf visueller Ebene mit Schärfe und Unschärfe erzeugt und der Blick dadurch gelenkt. Tiefe kann im zweidimensionalen Bild nur simuliert werden und diese Wirkung wird verstärkt, wenn der Sound unterstützend hinzukommt. Zum Teil kann im Ton auch eine Örtlichkeit oder Räumlichkeit erzählt werden, ohne dass diese im Bild zu sehen ist. Hintergrundgeräusche und das Hinzufügen des richtigen Halls auf die ansonsten meist sehr nah und trocken aufgenommenen Sounds sorgen für eine überzeugende Wahrnehmung von räumlicher Tiefe.

Versuche zu Raumklang und Rauschminderung

Im Rahmen der Bachelorarbeit wurden einige Sound-Parameter für Raumklang und Rauschminderung durch Blindtests untersucht. Die konzipierten Versuche können sie hier nachvollziehen.

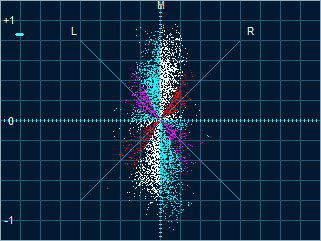

Der wichtigste Parameter für die akustische Untermalung von Räumlichkeit ist die Lautstärke. Befindet sich ein Objekt weiter weg, ist es leiser, als wenn es nah ist. Die Testteilnehmer bewerteten außerdem eine zusätzliche Frequenzbearbeitung positiv. Sowohl durch Absenken der hohen als auch der tiefen Frequenzen bei Entfernung des Objekts wurde die Räumlichkeit überzeugender wahrgenommen. Die beste räumliche Wirkung erzielt man jedoch, wenn zusätzlich zur Lautstärke- und Frequenzbearbeitung auch Kunsthall verwendet wurde. Die Lautstärke des Halls bleibt bei unterschiedlicher Entfernung der Geräuschquelle gleich, jedoch ändert sich das Verhältnis von Direktschall zu Diffusschall (Hall), sodass bei höherem Hallanteil das Objekt als weiter weg empfunden wird.

In der Mischung wird außerdem versucht, Probleme im Sound zu beheben, die durch den Schnitt nicht beseitigt werden konnten. So müssen Rauschen oder Verzerrungen möglichst effektiv entfernt werden und falls dies nicht möglich ist, gilt es, die Störungen möglichst unauffällig zu gestalten. Dies kann beispielsweise erreicht werden, indem die Störgeräusche von anderen Sounds, zum Beispiel Atmos, verdeckt werden.

Trotz fortschrittlicher Computertechnik ist es immer noch nur bedingt möglich, Rauschen aus einer Aufnahme effektiv zu entfernen. Durch Rauschen gehen Informationen des Signals verloren, die nachträglich nicht wieder hergestellt werden können. Wird das Rauschen entfernt, entstehen Artefakte (Phantomgeräusche) oder »Löcher« im Sound, die letztendlich auffälliger wirken, als das Rauschen selbst.

In einem weiteren Blindtest wurden verschiedene Methoden der Rauschminderung sowie die Akzeptanz gegenüber Rauschen untersucht. Die Testteilnehmer empfanden das Hintergrundrauschen bei der betrachteten Szene im Durchschnitt nicht als störend, obwohl es von allen deutlich wahrgenommen wurde.

Der Test ergab, dass das Rauschen am wirksamsten mit einem »Expander« vermindert werden kann. Leise Signale, etwa das Rauschen, werden durch den Expander noch leiser. So kann Rauschen ohne nennenswerte Einschränkung der Signalqualität um bis zu 3 dB ohne auffällige Effekte abgesenkt werden.

Bei der Verwendung eines automatischen Rauschminderungsprogramms (D-Noiser) bemerkten einige Testteilnehmer negative Auswirkungen auf das Signal. Der Sound wird metallisch und je nach Stärke der Rauschminderung entstehen Artefakte, die ähnlich wie die einer zu starken MP3-Reduktion klingen. Atemgeräusche und Hintergrundgeräusche leiden dadurch besonders.

Rauschen kann nur mit großem zeitlichen Aufwand vermindert werden. Besonders beim Zusammenschnitt von Sounds ist Rauschen der Kontinuität des Sounds sehr abträglich, da es oft in verschiedenen Aufnahmen unterschiedlich klingt. Damit kein Sprung im Sound hörbar ist, müssen die Rauschspektren einander angeglichen werden, was nur mit aufwändigen Filterungen erreicht werden kann. Somit muss der zeitliche Mehraufwand durch eine gute O-Ton-Aufnahme beim Dreh gegen höhere Kosten in der Nachbearbeitung abgewogen werden.

Fazit

Durch die Planung der Mittel und Mitarbeiter einer Produktion wird letztlich bereits im Vorfeld darüber entschieden, ob in der Audiopostproduktion überhaupt die Möglichkeit besteht, eine gute Tonspur zu produzieren. Schlechter O-Ton oder ein zu enger Zeitplan wirken sich direkt auf die Qualität des Sounds aus. Leider wird gerade bei Produktionen mit limitiertem Budget häufig am Sound gespart. Guter Sound muss aber nicht unbedingt teuer sein: Er braucht vor allem die nötige Aufmerksamkeit — und das nicht erst in der Postproduktion.

Autor: red

Anzeige

Most Popular

Anzeige

Newsletter

Anzeige

Anzeige

Anzeige