Anzeige

Home » NAB2015: HDR als wachsendes Thema

NAB2015: HDR als wachsendes Thema

Eine realitätsnähere Bildwiedergabe zu erzielen, das ist die treibende Kraft hinter vielen Weiterentwicklungen in der Bildtechnik: Im Idealfall soll der Blick auf einen Monitor oder eine Leinwand nicht mehr vom Blick aus einem Fenster zu unterscheiden sein.

Ein Mittel, um diesem Ziel näher zu kommen, ist die höhere Auflösung von 4K und mehr, die sich derzeit auf dem Vormarsch befindet. Das allein wird aber nicht ausreichen, denn es gibt eben auch noch andere Aspekte, die die visuelle Wahrnehmung des Menschen beeinflussen: etwa Bildrate, Dynamikumfang und Farbraum.

Moderne Kameras leisten aber in vielen Fällen auch unter diesen Gesichtspunkten schon mehr, als unser Fernsehsystem bislang darstellen kann. Das führt in der Praxis momentan dazu, dass ein großer Teil der Bildqualität, die man heutzutage mit modernen Kameras aufnehmen und mit aktuellen und kommenden Displays darstellen könnte, niemals beim Endkunden ankommt — selbst wenn der einen 4K- oder 8K-Monitor besitzt.

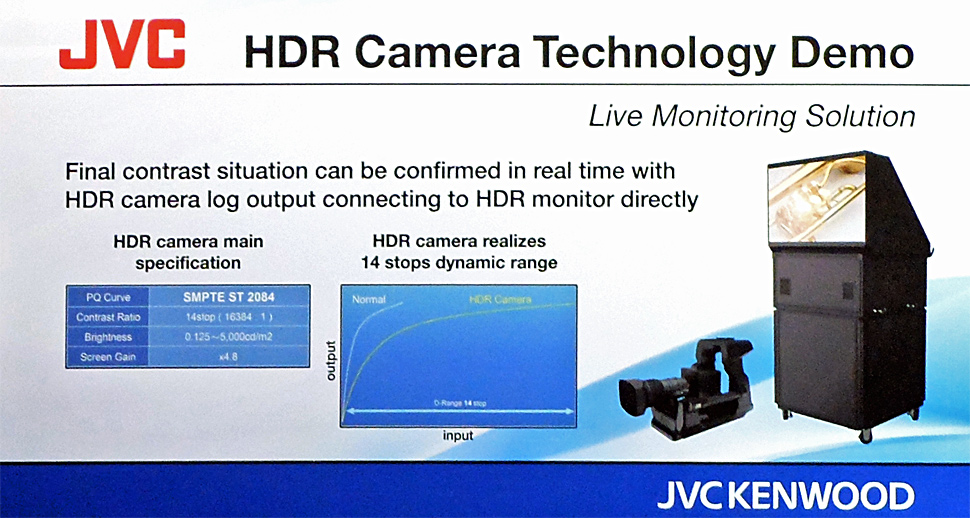

Da kann es nicht verwundern, dass nun im Kielwasser von 4K unter dem Oberbegriff High Dynamic Range (HDR), auch die Steigerung von Dynamikumfang und Farbraum im Videobereich weiter ins Zentrum des Interesses rücken: HDR war während der NAB2015 nicht nur Firmen wie Filmlight, Dolby, Technicolor, Arri und ein paar weiteren hoch spezialisierten Anbietern ein Thema, die sich schon länger damit befassen, sondern eben auch bei Mainstream-Anbietern wir JVC und Sony.

Was wird im Videobereich unter HDR verstanden?

Wählt man eine enge, klare Definition, dann geht es bei HDR um den Dynamikbereich oder Kontrastumfang des Bildsignals. Umgangssprachlich könnte man sagen, es geht darum, den Bereich zwischen dem schwärzesten Schwarz und dem weißesten Weiß innerhalb eines Bildes möglichst weit zu fassen. Man will also einen möglichsten großen Bereich zwischen dem hellsten und dem dunkelsten Punkt eines Bildes differenziert und fein abgestuft darstellen können.

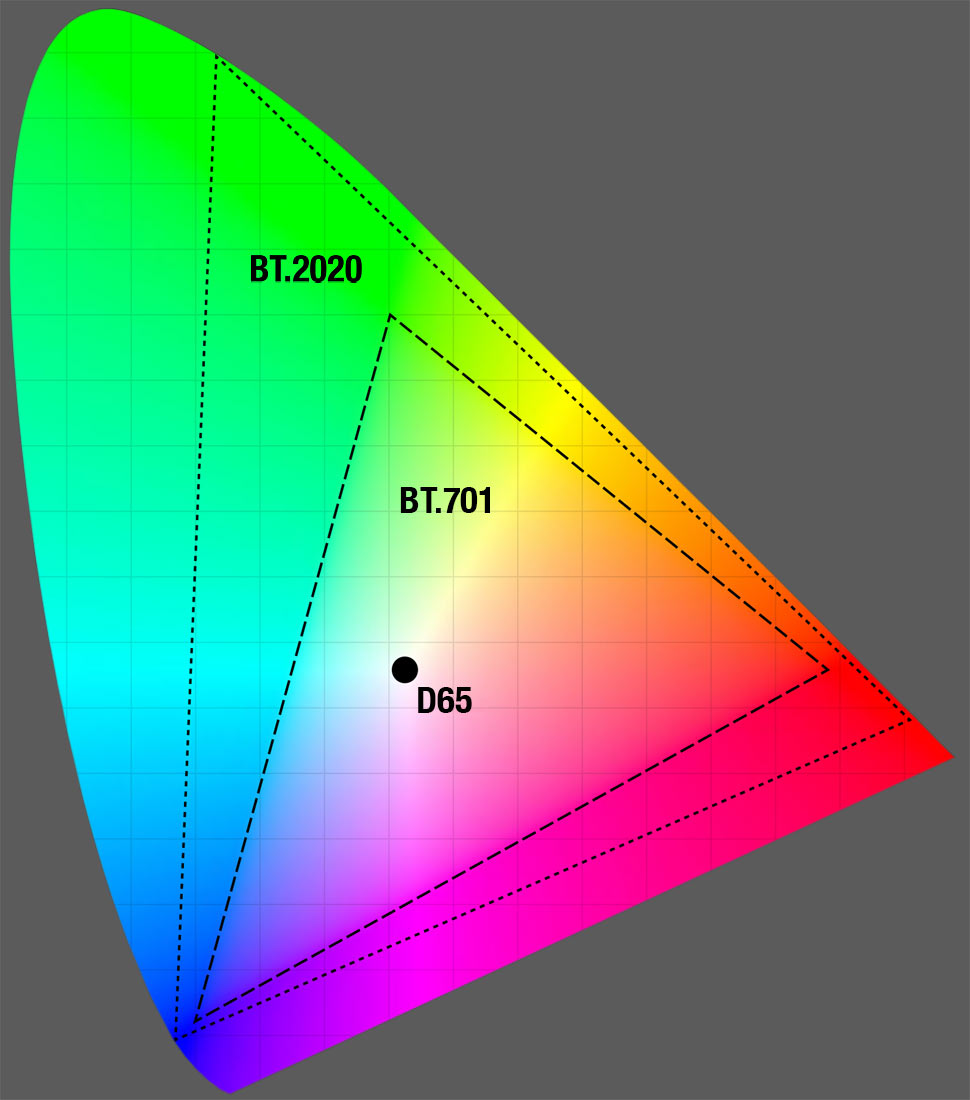

In der Praxis hat aber schon eine Vermischung dieser klaren Definition mit einem weiteren Aspekt begonnen. So verstehen manche unter HDR auch die gleichzeitige Ausdehnung des Farbraums. Eigentlich ist es ein weiteres, getrenntes Thema, die Zahl der realistisch darstellbaren Farben zu vergrößern, aber natürlich ist das ebenfalls sinnvoll, wenn man einen realitätsnäheren Bildeindruck erzielen will. In der Praxis wird wohl ohnehin beides parallel stattfinden, also fassen manche in der Branche auch beides unter dem Oberbegriff HDR zusammen und definieren so: Mehr Farben und einen größeren Helligkeitsbereich differenziert und fein abgestuft darstellen zu können, als das mit den bisher üblichen Videosystemen möglich ist, das ist HDR.

Wie wird HDR in den Markt getragen?

Hierbei haben verschiedene Hersteller verschiedene Interessen: Manche sehen HDR unabhängig von UHD oder 4K und denken über die Einführung im HD-Bereich nach. Andere haben vorrangig das Kino im Auge. Firmen wie Amazon und Netflix sehen in HDR eine Möglichkeit, ihre Streaming-Angebote von anderen Inhalten abzuheben. Display-Hersteller wollen am liebsten erstmal »normale« UHD-Monitore in den Markt schieben und dann erst im nächsten Schritt mit HDR den nächsten Kaufanreiz setzen.

Schwer zu sagen, was sich in diesem Kuddelmuddel an Interessen letztlich im Markt durchsetzen wird.

Ein bisschen Hintergrundwissen

Das menschliche Auge kann einen bestimmten Bereich an Farben und Helligkeitsstufen erfassen.

Die Farben, die der Mensch sehen kann, kann man auf verschiedene Weise darstellen. Eine der gängigen Methoden dafür ergibt ein zungenförmiges Diagramm: Hier sind — grob gesagt — alle Farben enthalten, die der Mensch wahrnehmen kann.

Keines der derzeit existierenden Bildverfahren kann aber dieses gesamte Farbspektrum darstellen, das der Mensch sehen kann — nur in der Natur sind alle Farben vorhanden. Ein Monitor oder Projektor zeigt immer nur einen Ausschnitt aus dem Farbspektrum.

Um eine gemeinsame Basis für Vergleiche, Messungen und technische Verfahren zu haben, wurden im Lauf der Jahre verschiedene, meist dreieckige Ausschnitte aus dem Farbspektrum definiert. Sie werden Farbraum genannt und tragen Zusatzbezeichnungen wie BT.701 (auch Rec.701 genannt) oder BT.2020. Je größer diese Farbräume, um so mehr Farben und um so natürlichere Bilder können damit dargestellt werden.

Die zweite wichtige Größe ist der Helligkeitsbereich, den man abbbilden, darstellen und sehen kann. Das Auge kann sich, wenn man ihm etwas Zeit gibt, auf eine enorme Spanne zwischen dunkel/schwarz und hell/weiß einstellen: Dazu wird die Pupillengröße verändert, es finden biochemische Anpassungen auf der Netzhaut und Änderungen in der Verarbeitung der ankommenden Reize im Gehirn statt.

Am wichtigsten für die Bildwiedergabe unter kontrollierten Bedingungen, wie sie in Büros oder Wohnzimmern herrschen, ist aber letztlich, wie groß der Helligkeitsbereich ist, den das Auge spontan verarbeiten kann. Hierfür gibt es verschiedene Messgrößen: etwa das Kontrastverhältnis von 100.000:1 oder den Kontrastumfang von 100 dB. Was auch immer man als Maß ansetzt: Die momentan für den Massenmarkt verfügbaren Systeme können am Ende der Kette nur einen Bruchteil davon darstellen.

Wenn der Kontrastumfang eines Geräts oder eines Bildsystems aber kleiner ist, als der des menschlichen Auges, wie etwa bei den derzeit üblichen TV-Systemen, dann weicht das wiedergegebene Bild in Bezug auf den Kontrastumfang von dem ab, was man vor Ort sehen würde: Für die Bildschirmdarstellung wird der tatsächlich in der Realität vorhandene Kontrastumfang entweder insgesamt gestaucht, oder man wählt einen bestimmten Abschnitt aus, der möglichst gut dargestellt werden soll und lässt den Rest im Schwarz »absaufen« oder im Weiß »überstrahlen«.

Ein weiterer Aspekt ist die vom Auge maximal verarbeitbare Leuchtdichte die jenseits von 20.000 cd/m2 (Nits) liegt. Zum Vergleich: Computer-Bildschirme erreichen typischerweise 200 bis 300 Nits. Kinoprojektoren schaffen 48 Nits.

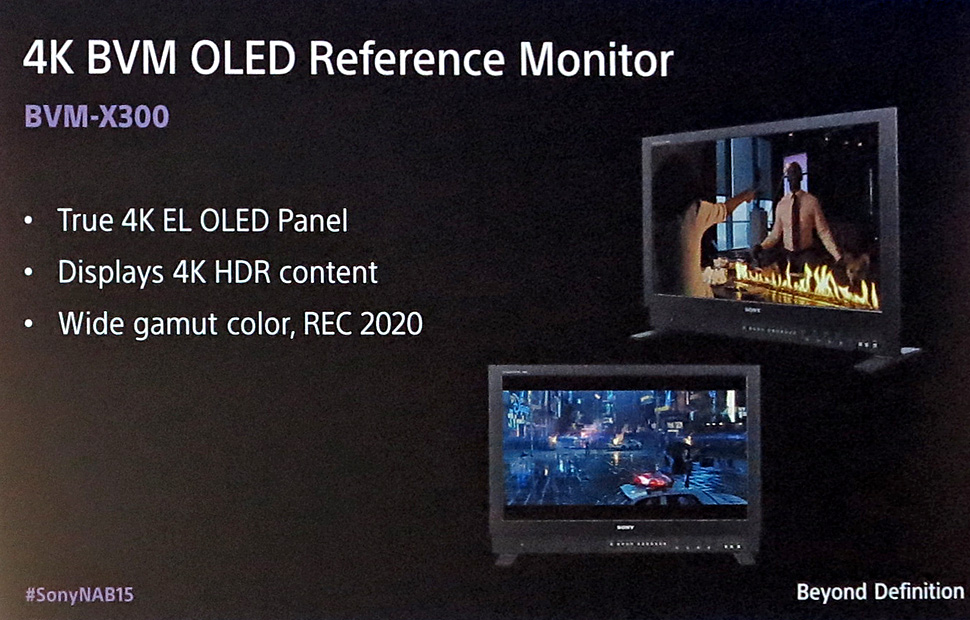

Stand der Gerätetechnik

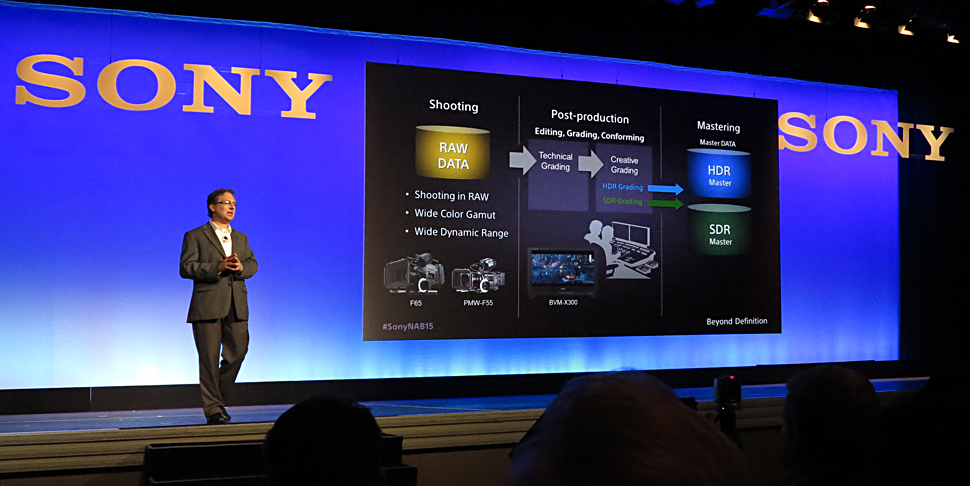

Moderne Kameras bieten bei der Aufnahme die Möglichkeit, einen größeren Dynamikumfang aufzuzeichnen, als man ihn anschließend mit den etablierten TV-Systemen darstellen kann.

Die beste Bildqualität, die derzeit auf breiter Basis im Markt verfügbar ist, stellt immer noch die Blu-ray Disc dar. Die Blu-ray Disc arbeitet im Farbraum Rec.701 und ist auf Displays mit 100 Nits optimiert. Die gleichen Eckwerte gelten im Grunde auch für Live-HD-Fernsehprogramm.

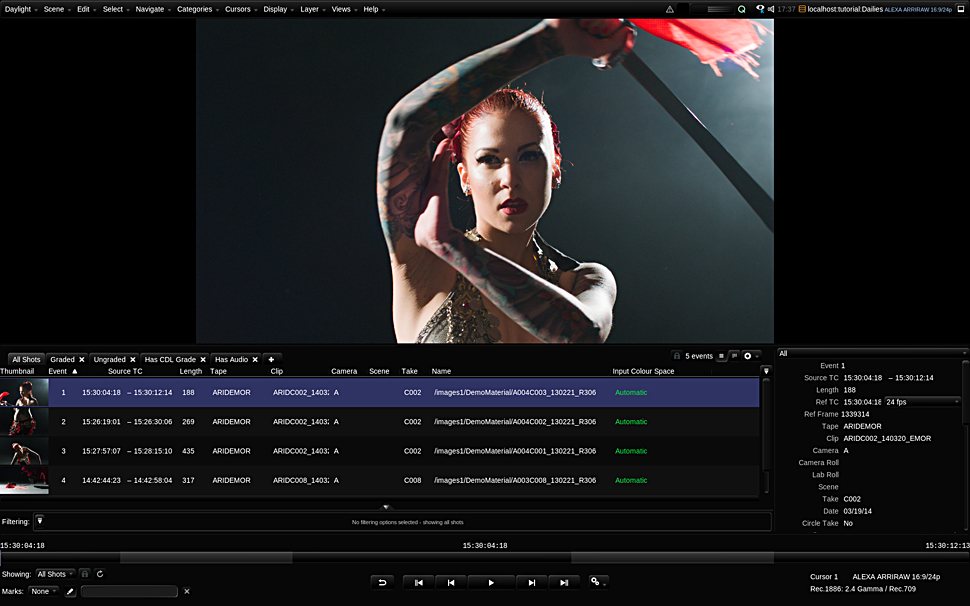

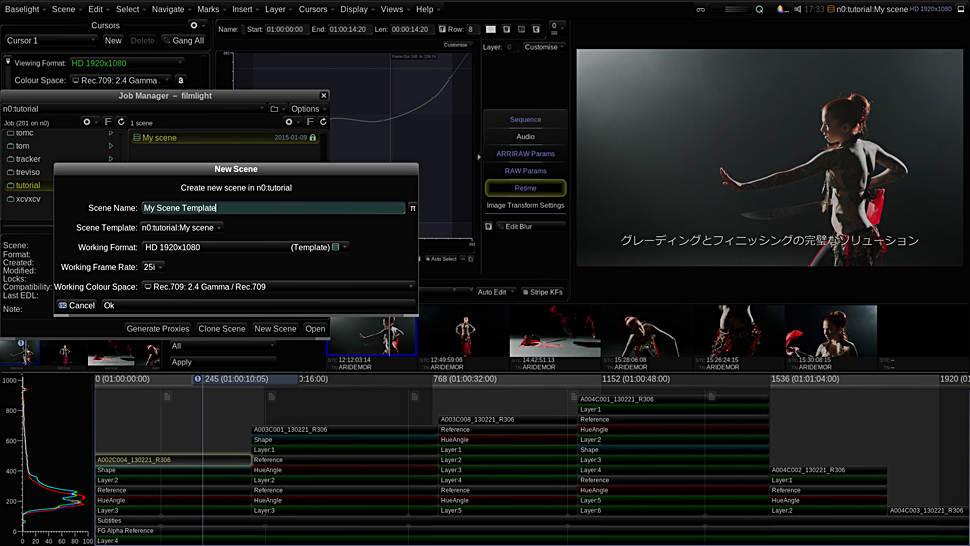

In der Praxis sind aber aufgrund der technischen Weiterentwicklung mittlerweile Displays verfügbar, die deutlich mehr können, sowohl was die Helligkeit, als auch was den Farbraum angeht — und das wollen die TV-Gerätehersteller natürlich auch ausnutzen und zeigen, um die Kunden zu überzeugen. Also wird das auf der BD vorliegende oder vom Sender ankommende Bildsignal »aufgeblasen« und mit jeweils herstellereigenen Techniken und Verfahren an die Möglichkeiten des Geräts »angepasst«. Was dabei auf der Strecke bleibt, ist die künstlerische, gestalterische Intention der Macher. Die haben möglicherweise sehr viel Zeit im Color Grading dafür verwendet, einen besonderen Look zu erzielen und so die Wirkung des Films zu unterstützen und zu verstärken. Wenn nun aber in Wahrheit am Ende der Produktionskette, bei der Vorführung des Films, der Look durch irgendwelche Funktionen im Fernsehgerät bestimmt und damit letztlich das Bildmaterial so verfälscht wird, dass es ganz anders rüberkommt, dann ist das letztlich weder im Sinne der Macher, noch der Zuschauer.

Ein weiteres Problemfeld besteht darin, was man denn heutzutage in der Postproduction, im Grading und Mastering als Maß der Dinge annehmen soll: Welche Vorführmöglichkeiten stehen denn beim Endkunden zur Verfügung? Welchen Sinn ergibt es, wenn man das Grading und Mastering mit Projektoren oder Monitoren realisiert, die mit dem, was in Kinos und in Wohnzimmern verfügbar ist, nur wenig gemeinsam haben? Oder wenn man andererseits die neuesten Möglichkeiten nicht nutzen kann, weil man kompatibel zum kleinsten gemeinsamen Nenner bleiben muss?

Hier sind also noch viele Fragen zu klären, aber die Themen HDR und Farbraumvergrößerung werden nun immerhin auf breiterer Basis aufgegriffen. Nun geht es darum, verbindliche, durchgängige Regeln und Standards zu schaffen, um das, was moderne Kameras können, auf modernen Displays optimal darstellen zu können.

Dann könnte man etwa auch daran denken, aus dem Raw-Material, das von vielen Produktionen vorliegt und einen viel größeren Dynamikumfang aufweist, als man ihn bisher nutzen konnte, neue HDR-Versionen von schon existierenden Filmen zu re-mastern. Es könnten somit vergleichsweise schnell HDR-Filme in größerer Zahl zur Verfügung stehen, man müsste nicht warten, bis die Technik sich nach und nach bei neuen Produktionen durchsetzt.

Empfehlungen der Redaktion:

10.04.2015 – NAB2015: So berichtet film-tv-video.de aus Las Vegas

07.05.2014 – NAB2014: Dolby Vision — mehr Bildqualität beim Endkunden

22.04.2015 – NAB2015-Video: HDR-Technologie-Demo bei JVC

19.09.2014 – IBC2014-Video: Sony zeigt 4K-Referenzmonitor

26.02.2015 – Echt scharf: 4K-Profimonitore

26.11.2014 – Netflix: 4K übers Netz

11.02.2015 – Youtube: neue Kanäle, neue Konzepte

Autor: red

Anzeige

Most Popular

Anzeige

Newsletter

Anzeige

Anzeige

Anzeige