Anzeige

Home » Generatives Erweitern in Premiere Pro Beta

Generatives Erweitern in Premiere Pro Beta

Praxis

Für unseren Test habe ich sowohl iPhone-Videos als auch Stockmaterial verwendet. Natürlich kann man sich Clips suchen, bei denen die KI wahrscheinlich gute Ergebnisse liefern wird, aber das ist in der Praxis ja eher selten der Fall. So habe ich verschiedene Szenarien herausgesucht: schlechte iPhone Qualität, Natur, Menschen, sich bewegende Objekte usw. Die Ergebnisse habe ich hier in Textform und Screenshots sowie einem Testvideo festgehalten.

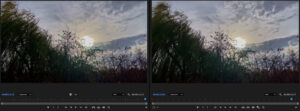

Garten

Mit dem iPhone habe ich im Garten sich bewegende Büsche gefilmt. Da die Betaversion aktuell nur HD akzeptiert, bügelte die KI die ohnehin schon geringen Details der Bäume ziemlich weg, die Bewegung der Blätter ebenfalls. Das generierte Video weist deshalb den typischen KI-Look auf und die Wolken springen etwas.

Als nächstes filmte ich meine Schuhe beim Gehen auf dem Rasen. Auch hier konnte das Ergebnis nicht so recht überzeugen. Das generierte Audio klang etwas dumpf, das Rauschen der Blätter durch den Wind wurde von der KI weggefiltert. Ganz anders sah es aber bei den qualitativ hochwertigeren Stockvideos aus, die ich in der nächsten Runde testete.

Business People

Bei den drei Menschen vor dem Fenster brauchte es zwei Versuche bis zu dem einigermaßen zufriedenstellenden Ergebnis.

Das Gesicht der Frau wurde gut dargestellt, die Bewegungen des Mannes ebenfalls. Lediglich der Himmel springt etwas und der Mann hat einen leichten, KI-typischen Comic Look.

Dies fällt in der Bewegung aber kaum auf, lediglich ein leichtes Ruckeln ist beim Wechsel von Original auf KI zu sehen. Hier fiel mir auch zum ersten Mal auf, dass sich das erste Frame der KI-Generierung fast immer doppelt. Deshalb sollte man ein Bild löschen, um einen flüssigen Übergang zu erhalten.

Steigerungspotenzial gibt es bei der Hand der Frau, sie wirkt ziemlich KI-typisch.

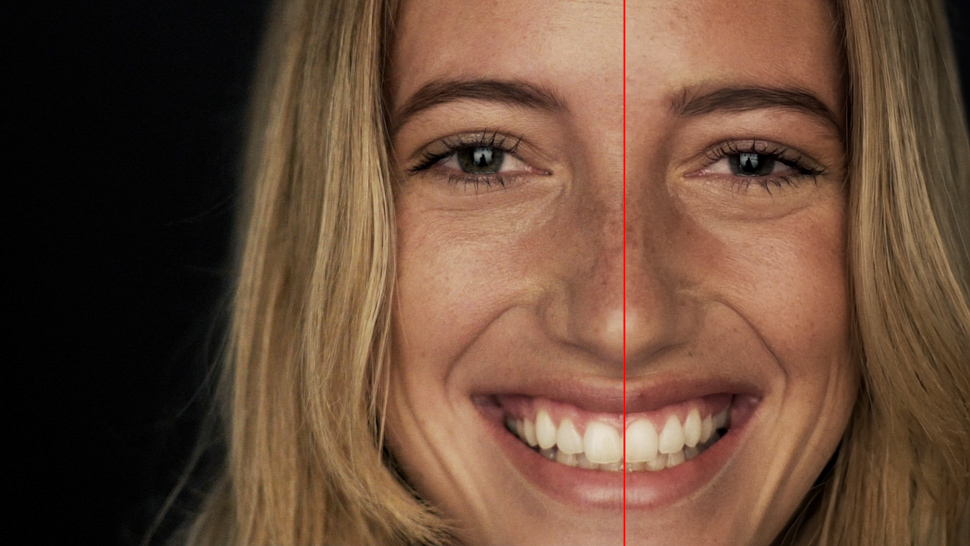

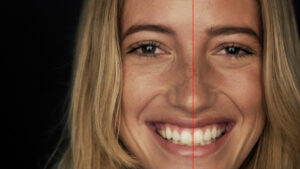

Close-Up Frau

Bei der Frau erzielte ich bei meinem Test die mit Abstand besten Ergebnisse. Feine Härchen und die Wimpern wurden komplett übernommen. Auch hier sind Helligkeitssprünge zu sehen, aber das Bildrauschen wurde durch die KI komplett eliminiert.

Abhilfe schaffen konnte ich mit zwei einfachen Dingen:

Rauschen auf das KI-Bild legen und die Sprünge in der Helligkeit mit Flicker Free von Digital Anarchy eliminieren. Das hat wunderbar geklappt und das KI-Bild sehr verbessert.

Allerdings ist das eben ein weiterer Zusatzschritt. Bedenkt man aber, dass es in After Effects ja den Effekt »Körnung anpassen« gibt, sollte es ein Leichtes sein, dies und auch eine Art Flicker-Reduzierung in die fertige KI einzubinden. Alles in allem also ein wirklich gutes Ergebnis mit der KI.

Ich habe übrigens noch versucht, das Video der Frau im LOG-Format durch die KI zu jagen – hier wirkte das Ergebnis aber etwas plastikartig. Aktuell sollte man also am besten nur farbkorrigierte Videos verwenden, die der KI mehr Informationen liefern.

Gemüsepfanne

Die Bewegung der Pfanne wurde gut weitergeführt, das Feuer und dessen Bewegung ebenfalls. Man muss schon sehr genau hinsehen, um bei Pfanne und Inhalt den KI-Comiclook zu sehen.

Party

Hier hat die KI die Bewegungen der tanzenden Menschen wirklich gut weitergeführt, nur bei den Händen gab es wieder Probleme.

Das generierte Video wirkte wie gemalt, in der Bewegung ist dies aber kaum zu sehen und auf einem kleinen Bildschirm wird man das nicht erkennen.

Tanzende Silhouetten

Bei der ersten Generierung spielten die Schatten verrückt. Im zweiten Versuch sah die Sache aber schon ganz anders aus. Ein Unterschied zum Original ist kaum zu erkennen.

Sieht man sich die Details an, wurden ausgefranste Kanten von der KI sogar noch verbessert (was natürlich wieder zu einem leichten Sprung führte). Dieses KI-generierte Video wäre wie der Close-Up der Frau problemlos nutzbar.

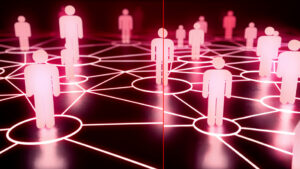

Neon-Figuren

Als letzten Test wählte ich ein komplett grafisches Video. Hier löschte ich ebenfalls das erste KI-generierte Bild, um einen sauberen Übergang zu erhalten.

Die ersten Frames haben weiterhin etwas geflackert, beim zweiten Versuch habe ich die Generierung ein paar Sekunden früher angesetzt – das hat das Flackern eliminiert. In der Praxis wird man allerdings nicht immer die Freiheit haben, einfach eine andere Stelle im Video zu suchen.

Ansonsten bin ich mit dieser Generierung auch zufrieden, die KI-Version hatte lediglich etwas mehr Glow auf den Figuren und weniger Zeichnung in den Highlights.

Audio

Anders als bei Video muss der Audioclip mindestens drei Sekunden lang sein. Erweitert habe ich eine Lagerfeueratmosphäre, das hat sehr gut funktioniert.

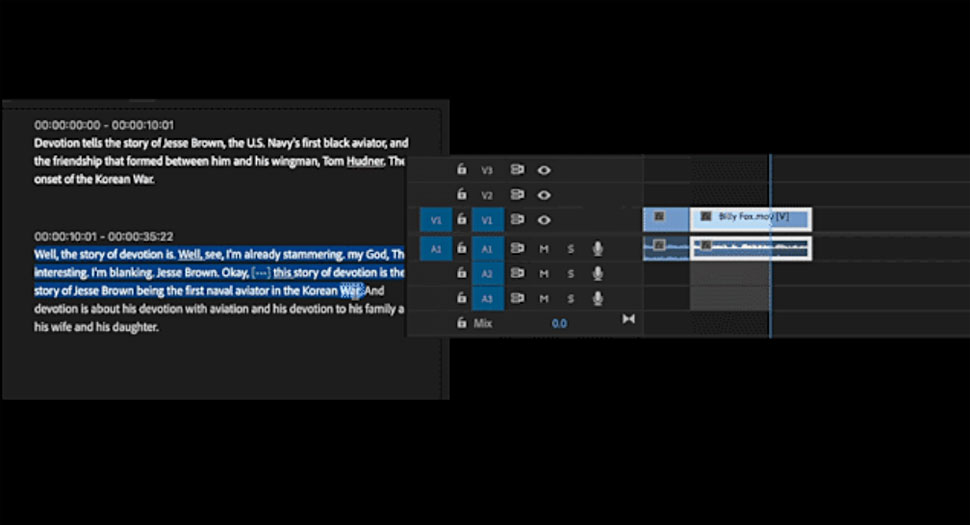

Weiterhin habe ich einen Restauranthintergrund verlängern lassen. Hier wurden durch die KI die Kanäle vermischt, was zu einem deutlich hörbaren Sprung führte. Das Murmeln im Hintergrund wurde übernommen, verständliche Gespräche allerdings nicht – dies deckt sich mit dem Versuch, einen Radiosprecher zu verlängern. Das ist von Adobe so gewollt. Die Hilfe sagt: »Mit Generatives Erweitern können keine gesprochenen Dialoge erstellt oder erweitert werden. Beim Erweitern werden die vorhandenen Dialoge stummgeschaltet, um die Integrität des ursprünglichen Sprachinhalts zu wahren.«

Um eine Hintergrundatmosphäre zu verlängern, die auch wirklich nur leise im Hintergrund läuft, kann man die KI aber nutzen.

Fazit

Wie anfangs bereits erwähnt, befindet sich das generative KI-Feature noch in der Betaphase. Aber man kann je nach Anwendungsfall schon sehr gute Ergebnisse erzielen – aber eben nicht immer. Es braucht teilweise noch eigenes Zutun.

Nutzt man eine Blende, kann man den generierten Inhalt manchmal so gut kaschieren, dass es eigentlich nicht mehr auffällt. Es hilft auch, »generatives Erweitern« mehrfach auszuführen, um bessere Ergebnisse zu erzielen.

In der finalen Version wäre es natürlich schön, mit 4K-Material arbeiten zu können.

Natürlich macht es auch einen Unterschied, auf welchem Display das Endprodukt betrachtet wird. Bei einem KI-generierten Video auf Instagram wird man weniger erkennen als auf einem großen 4K-Schirm.

Insgesamt kann man aber schon erkennen, wo die Reise hingeht: Wir sind auf einem guten Weg.

Seite 1: Einsatzbereiche, Funktionsprinzip

Seite 2: Beispiele und Fazit

Autor: Sas Kaykha, Nonkonform

Bildrechte: Sas Kaykha

Anzeige

Most Popular

Anzeige

Newsletter

Anzeige

Anzeige

Anzeige